A Microsoft emitiu um alerta sobre uma nova campanha de ataques cibernéticos que utiliza o WhatsApp […]

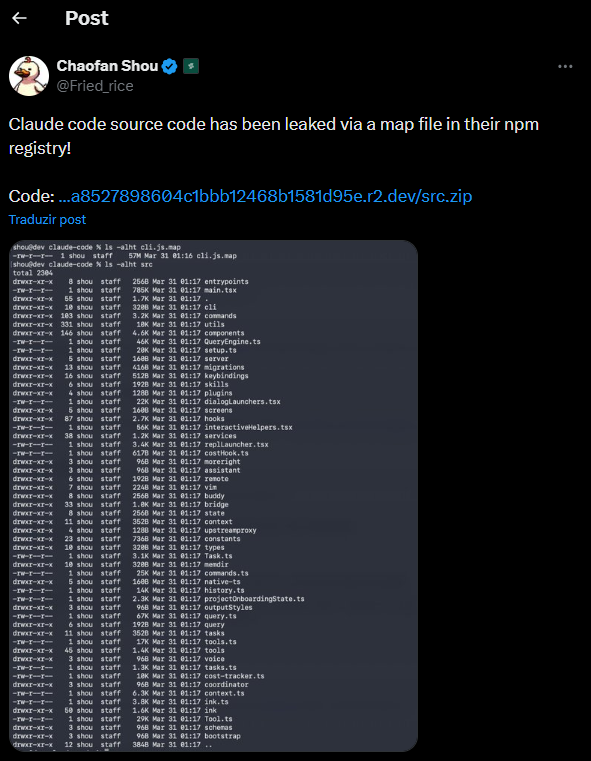

Um erro interno da Anthropic resultou no vazamento de parte significativa do código-fonte do Claude Code, seu assistente de programação baseado em inteligência artificial. O incidente ocorreu após a publicação da versão 2.1.88 do pacote no npm, que incluía inadvertidamente um arquivo de mapeamento contendo cerca de 2 mil arquivos em TypeScript e mais de 500 mil linhas de código.

Segundo a empresa, não houve exposição de dados sensíveis de clientes nem credenciais, reforçando que o caso não se trata de uma violação direta de segurança, mas sim de uma falha operacional causada por erro humano. Ainda assim, o impacto é relevante: o código vazado oferece uma visão detalhada da arquitetura interna da ferramenta, incluindo mecanismos avançados de orquestração multiagente, execução de comandos e gerenciamento de contexto para lidar com limitações de memória dos modelos de linguagem.

A exposição revelou funcionalidades estratégicas, como o sistema KAIROS, que permite ao Claude operar de forma autônoma em segundo plano, executando tarefas e corrigindo erros sem intervenção humana. Também foram identificados modos avançados, como o “dream mode”, voltado à geração contínua de ideias, além de um controverso “Undercover Mode”, projetado para realizar contribuições discretas em projetos open source sem revelar sua origem.

Outro ponto sensível diz respeito às técnicas utilizadas pela empresa para proteger seus modelos contra engenharia reversa e roubo de propriedade intelectual. O código indica que o sistema injeta informações falsas em determinadas interações com APIs, com o objetivo de contaminar dados que possam ser coletados por concorrentes — uma estratégia defensiva pouco comum e que levanta debates éticos e técnicos.

Apesar de não envolver diretamente dados de usuários, o vazamento aumenta significativamente o risco de exploração por hackers. Com acesso à lógica interna da ferramenta, invasores podem desenvolver ataques mais sofisticados, explorando vulnerabilidades na gestão de contexto ou manipulando fluxos de execução para inserir comandos maliciosos e extrair informações.

A situação se agrava com a identificação de um possível ataque à cadeia de suprimentos. Usuários que instalaram o pacote durante uma janela específica podem ter sido expostos a uma versão comprometida contendo um trojan de acesso remoto. Além disso, grupos hackers já começaram a explorar o incidente criando pacotes falsos com nomes semelhantes aos internos da Anthropic, visando ataques de “dependency confusion” — técnica que induz desenvolvedores a instalar bibliotecas maliciosas.

O episódio ocorre poucos dias após outro incidente envolvendo a empresa, quando informações internas e detalhes de um novo modelo de IA ficaram expostos em um sistema de gerenciamento de conteúdo. A recorrência levanta questionamentos sobre a maturidade dos processos de segurança e governança em empresas que estão na vanguarda da corrida por inteligência artificial.

ARTIGOS RELACIONADOS

Continue navegando em nosso blog.

ASSINE NOSSO NEWSLETTER

Enviamos notícias, dicas e ofertas.

DEIXE UM COMENTÁRIO